Warum ChatGPT nicht wirklich mit dir spricht, sondern nur sehr gut im Raten ist.

Kurz & bündig

Frage: Weiß ChatGPT, wovon es spricht?Antwort: Nein. Sprach-KIs wie ChatGPT haben kein Weltwissen und kein Bewusstsein. Sie sind mathematische Systeme, die Wahrscheinlichkeiten berechnen: Welches Wort folgt statistisch am ehesten auf das vorherige? Sie „verstehen“ den Text nicht, sie führen ihn nur logisch fort – ähnlich wie die automatische Wortvorschlags-Funktion am Handy, nur viel schlauer.Inhaltsverzeichnis

Der Papagei mit dem Superhirn

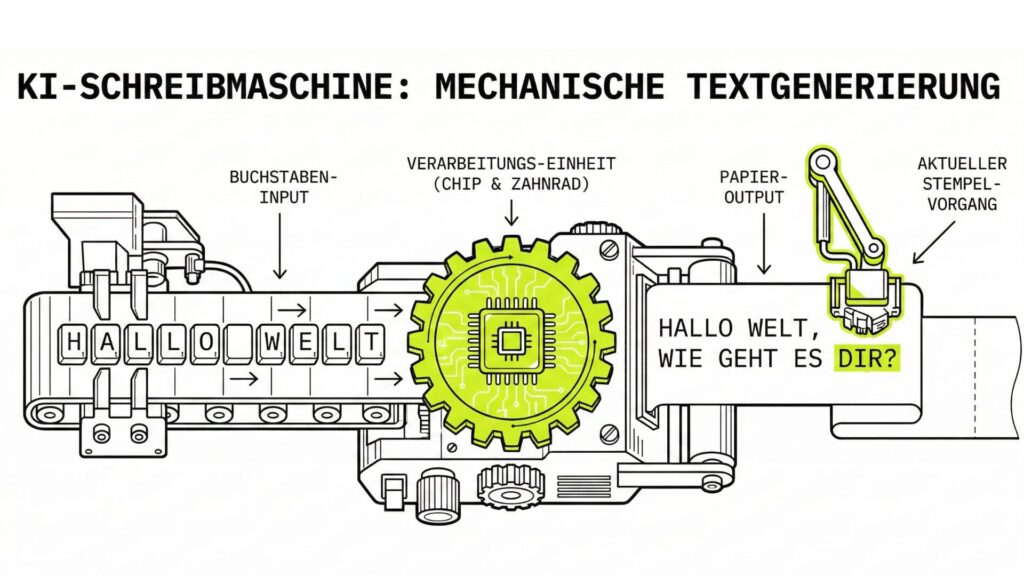

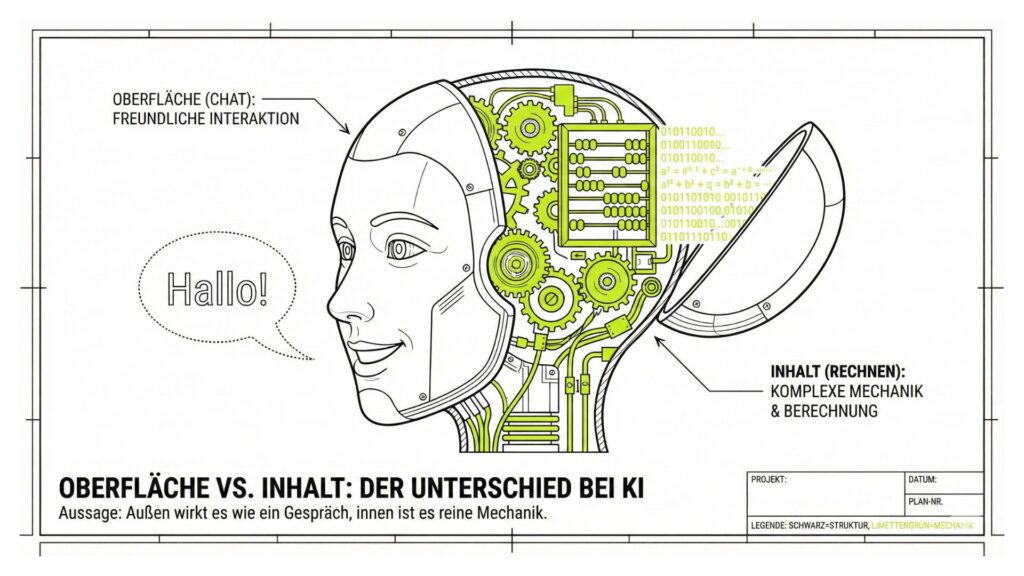

Wenn wir mit modernen Chatbots schreiben, fühlt es sich oft gespenstisch menschlich an. Sie machen Witze, sie entschuldigen sich, sie formulieren höflich. Man ist schnell versucht zu glauben: „Da muss doch jemand zu Hause sein.“Doch der Schein trügt. Man nennt diese Systeme auch „Large Language Models“ (Große Sprachmodelle). Stell dir einen Papagei vor, der jedes Buch, jeden Artikel und jedes Internet-Forum der Welt gelesen hat. Er kann Sätze perfekt nachplappern und neu kombinieren. Aber er weiß nicht, was „Liebe“, „Trauer“ oder „Wahrheit“ bedeutet. Er kennt nur die Worte, nicht den Sinn.Das Prinzip: Autocomplete auf Steroiden

Das technische Prinzip hinter ChatGPT kennst du bereits von deinem Smartphone.Das Handy-Beispiel

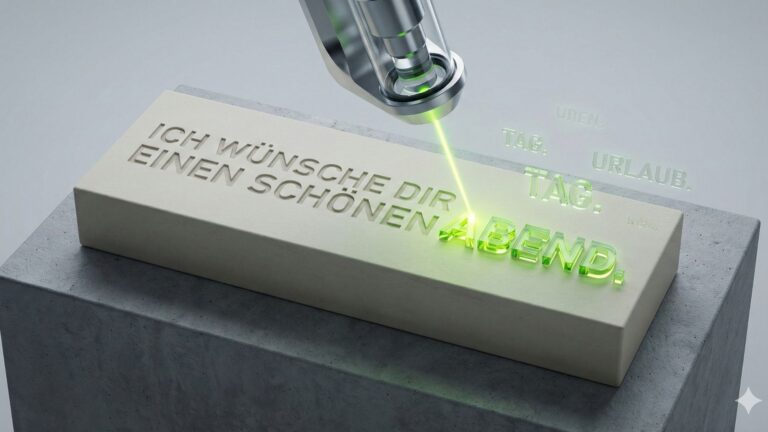

Wenn du auf WhatsApp tippst: „Ich wünsche dir einen schönen…“, schlägt dein Handy sofort vor: „…Abend“ oder „…Tag“.

Woher weiß es das?

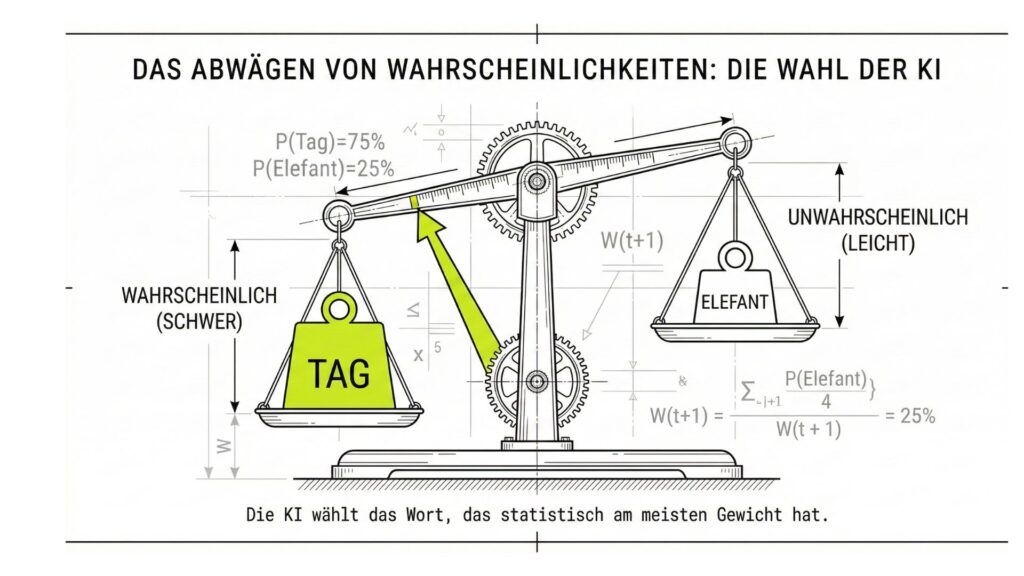

Es hat gelernt, dass nach „schönen“ sehr oft „Tag“ oder „Abend“ kommt. Es würde niemals „Elefant“ vorschlagen, weil das statistisch unwahrscheinlich ist.

ChatGPT macht genau das Gleiche – nur viel komplexer. Es schaut sich nicht nur das letzte Wort an, sondern den ganzen Absatz davor, um das nächste Wort zu erraten.

Wie die „Antwort“ entsteht

Die KI schreibt eine Antwort nicht, weil sie eine Idee hat. Sie berechnet sie Wort für Wort.Stell dir vor, du fragst: „Wer schrieb Faust?“- Die KI analysiert die Wörter. Sie merkt: „Schrieb“ und „Faust“ tauchen in ihren Trainingsdaten oft in der Nähe von „Goethe“ auf.

- Sie berechnet: Welches Wort hat die höchste Wahrscheinlichkeit, als Start der Antwort zu dienen? -> „Johann“.

- Dann nimmt sie „Johann“ und berechnet das nächste: -> „Wolfgang“.

- Dann nimmt sie „Johann Wolfgang“ und berechnet: -> „von“.

- Und so weiter: -> „Goethe“.

Die Gefahr: Warum die KI so überzeugend lügt

Weil die KI nur auf Wahrscheinlichkeiten achtet und nicht auf Fakten, kann sie völlig überzeugend Unsinn erzählen. Fachleute nennen das „Halluzinieren“.Die plausible Lüge

Fragst du die KI nach einem erfundenen Ereignis, z.B.: „Wann war die erste Mondlandung der Schweiz?“, kann es sein, dass sie antwortet: „Die erste Schweizer Mondmission fand 1988 statt…“

Warum? Weil die Wörter „Schweiz“, „Mondmission“ und eine Jahreszahl statistisch gut zusammenklingen. Der Satz ist grammatikalisch perfekt und klingt logisch – er ist nur inhaltlich frei erfunden.

Deshalb gilt: ChatGPT ist ein Text-Profi, aber kein Fakten-Lexikon.

Fazit: Ein Werkzeug für Form, nicht für Inhalt

Bedeutet das, KI ist nutzlos? Keineswegs. Sie ist großartig darin, Texte umzuformulieren, Zusammenfassungen zu schreiben oder Ideen zu liefern. Aber du musst der Chefredakteur bleiben. Du prüfst die Fakten, die KI liefert die schönen Sätze.Glossar: Die Welt der Sprach-KI

| Begriff | Erklärung |

|---|---|

| LLM (Large Language Model) | Ein „Großes Sprachmodell“. Eine KI, die mit riesigen Textmengen trainiert wurde, um Sprache zu verstehen und zu erzeugen (z.B. GPT-4). |

| Prompt | Die Eingabeaufforderung (deine Frage oder Anweisung), die du in das Chat-Fenster tippst. |

| Halluzination | Wenn eine KI eine falsche Information erfindet, diese aber sehr überzeugend als Fakt präsentiert. |

| Token | KIs lesen keine ganzen Wörter, sondern Silben-Bausteine. Ein „Token“ ist so ein Baustein (z.B. ist „Hausaufgaben“ oft in „Haus“ und „aufgaben“ zerlegt). |

Weiterführende Informationen

Interne Links

- vorheriges Kapitel – Warum Daten so wichtig sind (Das Problem mit Bias & Vorurteilen)

- nächstes Kapitel – Wie KI Bilder aus dem Nichts erschafft