Vom Turing-Test bis ChatGPT: Warum die „neue“ Technik eigentlich 70 Jahre alt ist.

Kurz & bündig

Frage: Ist Künstliche Intelligenz eine Erfindung der letzten Jahre?Antwort: Nein, die Idee ist über 70 Jahre alt. Alan Turing fragte schon 1950: „Können Maschinen denken?“. Dass KI erst heute boomt, liegt nicht an einer neuen Erfindung, sondern daran, dass Computer endlich schnell genug sind und durch das Internet genügend Daten zum Trainieren haben.Inhaltsverzeichnis

Eine alte Idee erwacht zum Leben

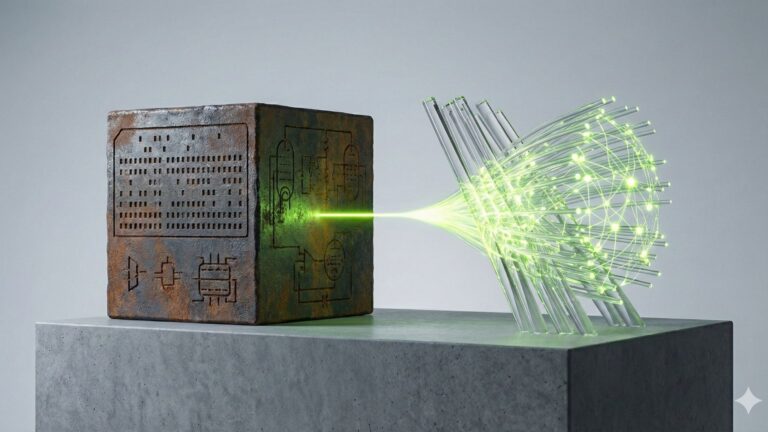

Wenn du heute die Zeitung aufschlägst, könntest du meinen, Künstliche Intelligenz (KI) sei quasi über Nacht entstanden. Plötzlich ist sie da: Sie schreibt Gedichte, besteht medizinische Examina und fährt Autos.Doch der Schein trügt. Die „neue“ Technologie ist eigentlich ein sehr alter Traum. Sie hat eine lange Geschichte voller Euphorie, enttäuschter Hoffnungen und technischer Sackgassen hinter sich. Wer diese Geschichte kennt, lässt sich von aktuellen Schlagzeilen weniger leicht verunsichern – denn du weißt dann: Das hier ist keine Magie, sondern das Ergebnis jahrzehntelanger mathematischer Evolution.1950: Die Geburt einer Vision (Alan Turing)

Lange bevor es Smartphones oder das Internet gab, stellte sich ein britischer Mathematiker eine entscheidende Frage. Alan Turing, der im Zweiten Weltkrieg half, den Enigma-Code der Deutschen zu knacken, veröffentlichte 1950 einen Aufsatz mit dem Titel: „Können Maschinen denken?“Er schlug ein Experiment vor, das heute als Turing-Test berühmt ist: Ein Mensch chattet mit zwei unbekannten Partnern. Einer ist ein Mensch, der andere eine Maschine. Wenn der Tester nicht mehr unterscheiden kann, wer von beiden die Maschine ist, gilt die Maschine als „intelligent“.Der Chat-Bot beim Kundenservice

Vielleicht hast du das schon erlebt: Du schreibst auf der Website deiner Bank oder Versicherung eine Nachricht an den Support. Die Antwort kommt sofort: „Hallo, wie kann ich dir helfen?“

Oft merkst du erst nach einigen Sätzen, dass du nicht mit einem Menschen schreibst, sondern mit einem Programm. In diesem Moment erlebst du eine moderne Form des Turing-Tests: Die Maschine versucht, menschliches Verhalten so gut zu imitieren, dass der Unterschied im Dialog verschwimmt.

1956: Ein Sommer der großen Versprechen

Der eigentliche Begriff „Artificial Intelligence“ (Künstliche Intelligenz) fiel erst sechs Jahre später. Im Sommer 1956 trafen sich junge Wissenschaftler am Dartmouth College in den USA.Ihre Annahme damals: Jeder Aspekt des Lernens lässt sich so präzise beschreiben, dass eine Maschine ihn simulieren kann. Man glaubte, es sei nur eine Frage von wenigen Jahren, bis Computer Schach spielen, Sprachen übersetzen und Probleme lösen wie ein Mensch. Rückblickend wissen wir: Sie hatten die enorme Komplexität des menschlichen Gehirns massiv unterschätzt.Der „KI-Winter“: Warum es so lange still war

In den 1970er und 80er Jahren wurde es still um die KI. Die hochtrabenden Versprechen konnten nicht gehalten werden, Forschungsgelder wurden gestrichen. Diese Phasen nennt man heute die „KI-Winter“.Warum es damals scheitern mussteErinnerst du dich an die Heimcomputer der 80er Jahre? Ein C64 hatte etwa 64 Kilobyte Arbeitsspeicher. Ein durchschnittliches Smartphone hat heute millionenfach mehr Speicher und Rechenkraft.

Die Forscher hatten damals zwar die richtigen mathematischen Ideen, aber es fehlte der „Motor“. Es ist, als hätten sie versucht, mit einem Rasenmäher-Motor (alte Computer) eine Rakete (KI) ins All zu schießen.

Es fehlte damals an drei Dingen:- 💾 Zu wenig Speicher: Komplexe Datenbanken passten auf keine Festplatte.

- 🐌 Zu langsame Rechner: Berechnungen dauerten Jahre statt Sekunden.

- 📚 Keine Daten: Es gab kein Internet zum „Nachlesen“ für die KI.

Der Durchbruch: Warum jetzt?

Warum erleben wir also seit etwa 2010 und besonders seit 2022 (ChatGPT) diesen gewaltigen Boom? Es ist eine Kombination aus drei Faktoren, die endlich zusammenkamen:| Faktor | Was sich geändert hat |

|---|---|

| Rechenkraft | Spezielle Computerchips (GPUs), die ursprünglich für Videospiele entwickelt wurden, erwiesen sich als perfekt für KI-Berechnungen. |

| Big Data | Das Internet lieferte plötzlich Milliarden von Texten und Bildern. Die KI hatte endlich genug „Lesestoff“ zum Üben. |

| Neuronale Netze | Man ging weg von starren Regeln („Wenn A, dann B“) hin zum Maschinellen Lernen, das sich am Aufbau des Gehirns orientiert. |

Was du jetzt tun kannst

- 🧐 Gelassen bleiben: Wenn du das nächste Mal einen Hype-Artikel liest, erinnere dich: Die Grundlagen sind reine Mathematik und Jahrzehnte alt.

- 📖 Weiterlesen: Im nächsten Kapitel schauen wir uns an, wie genau dieses „Lernen“ funktioniert.

Glossar: Historische Begriffe verständlich erklärt

| Begriff | Erklärung |

|---|---|

| Turing-Test | Ein Gedankenexperiment von 1950. Es prüft, ob eine Maschine einen Menschen in einer Unterhaltung so täuschen kann, dass er sie für einen Menschen hält. |

| KI-Winter | Bezeichnung für Phasen (z.B. in den 70ern), in denen das Interesse und die Gelder für KI-Forschung versiegten, weil die Technik stagnierte. |

| Big Data | Riesige Datenmengen (aus dem Internet, Sensoren, etc.), die so groß sind, dass nur Computer sie auswerten können. Sie sind das „Futter“ für moderne KI. |

| Dartmouth Conference | Ein Treffen im Jahr 1956, bei dem der Begriff „Artificial Intelligence“ erstmals offiziell geprägt wurde. |

Weiterführende Informationen

Interne Links