Maschinelles Lernen einfach erklärt: Warum Computer nicht programmiert, sondern trainiert werden.

Kurz & bündig

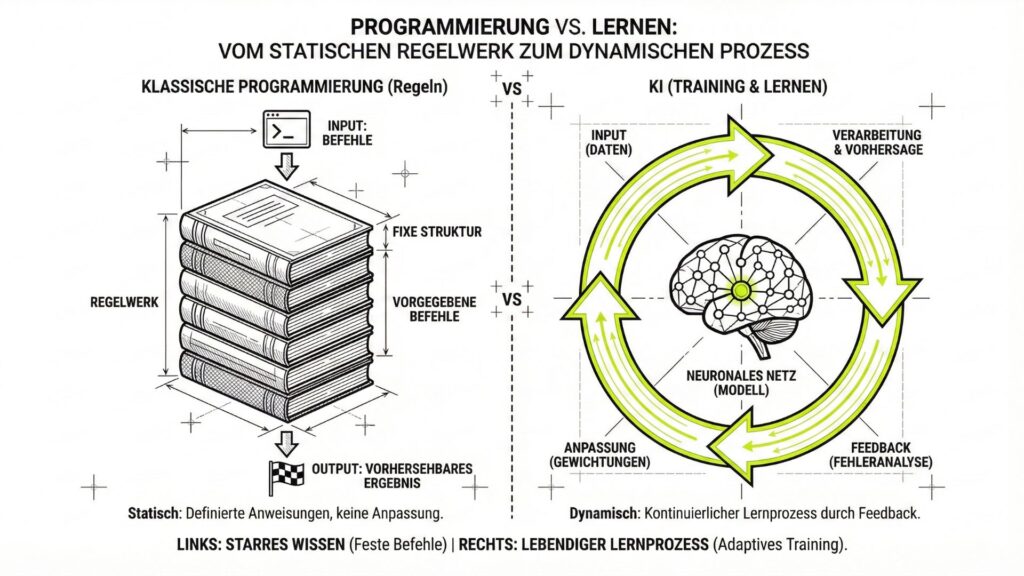

Frage: Muss man einer KI jede Antwort einzeln einprogrammieren?Antwort: Nein. Moderne KI wird nicht programmiert wie eine klassische Software („Wenn A passiert, mach B“), sondern sie wird trainiert. Man zeigt ihr tausende Beispiele und lässt sie so lange üben, bis sie die Regeln selbst erkennt – ähnlich wie ein Schüler, der ein Instrument lernt.Inhaltsverzeichnis

Früher vs. Heute: Der Klavier-Vergleich

Um den gewaltigen Unterschied zwischen klassischen Computerprogrammen (wie Excel oder Word) und moderner KI zu verstehen, stellen wir uns vor, wir wollten einem Computer das Klavierspielen beibringen.Die alte Methode (Klassische Programmierung): Ein Programmierer schreibt jede einzelne Note auf. Er definiert exakt: „Drücke Taste C für 0,5 Sekunden, dann Taste E für 0,2 Sekunden.“ Das Ergebnis ist mechanisch perfekt. Aber wehe, das Klavier ist leicht verstimmt oder das Notenblatt fällt runter. Das Programm bricht ab, weil es nur stur Regeln befolgt. Es kann nicht improvisieren und nicht auf Neues reagieren.Die neue Methode (Maschinelles Lernen): Hier gibt es keinen strengen Bauplan. Stattdessen setzt man die KI ans Klavier und sagt: „Spiel mir Mozart!“ Die KI drückt zufällige Tasten. Es klingt schrecklich (Krach). Das System bekommt sofort Feedback: „Falsch! Das war kein Mozart.“ Die KI versucht es erneut, ändert die Tastenabfolge minimal. Wieder: „Falsch, aber etwas besser.“Diesen Prozess wiederholt sie millionenfach in rasender Geschwindigkeit. Irgendwann hat sie durch reines Ausprobieren und Feedback-Lernen (Training) herausgefunden, welche Tastenfolge wie Mozart klingt. Sie hat die Melodie nicht auswendig gelernt – sie hat das Prinzip „Mozart“ verstanden.Wie das „Üben“ in der Praxis funktioniert

Natürlich sitzen Computer nicht an Klavieren. Aber das Prinzip ist identisch. Statt Noten üben sie mit Daten.Beispiel: Hund oder Katze?

Stell dir vor, du willst einem Computer beibringen, Hunde von Katzen zu unterscheiden.

Ohne KI müsstest du Regeln schreiben: „Wenn spitze Ohren, dann Katze.“ (Problem: Schäferhunde haben auch spitze Ohren. Das Programm scheitert.)

Mit KI (Training): Du zeigst der KI 10.000 Bilder von Katzen und 10.000 Bilder von Hunden. Am Anfang rät sie blind.

Jedes Mal, wenn sie falsch liegt, passt sie ihre internen Formeln („Gewichtungen“) etwas an. Nach 20.000 Bildern hat sie statistische Muster erkannt, die selbst wir Menschen kaum benennen können (z.B. das Verhältnis von Nasenbreite zu Augenabstand).

Warum KI trotzdem nicht „denkt“

Es ist verlockend, diesem Prozess menschliche Eigenschaften zuzuschreiben („Die KI übt fleißig“). Aber Vorsicht: Es ist reine Mathematik.Wenn ein Kind ein Klavierstück lernt, versteht es die Traurigkeit oder Fröhlichkeit der Musik. Wenn eine KI das Stück lernt, minimiert sie nur eine Fehlerquote. Sie weiß nicht, was „Musik“ ist. Sie weiß nur, welche Tastenabfolge zum Ziel „wenig Fehler“ führt.Deshalb sprechen Experten ungern von „Lernen“, sondern lieber von „Training“ oder „Mustererkennung“. Die Maschine versteht den Sinn nicht, sie imitiert nur perfekt das Ergebnis.

Warum Training so viele Daten braucht

Ein Menschenkind muss nur drei Katzen sehen, um eine vierte zu erkennen. Unser Gehirn ist unglaublich effizient. Eine KI braucht Tausende oder Millionen Beispiele.Warum? Weil ihr das Weltwissen fehlt. Sie weiß nicht, dass Katzen Tiere sind, dass sie Fell haben oder lebendig sind. Für die KI ist ein Katzenbild nur eine Ansammlung von farbigen Pixeln. Um darin die Struktur „Katze“ zu finden, braucht sie diese gewaltige Menge an Übungsmaterial (Daten).Fazit: Fehler sind Teil des Systems

Bei klassischer Software (z.B. einem Taschenrechner) ist 2+2 immer 4. Wenn nicht, ist das Gerät kaputt. Bei KI ist das anders. Da sie auf Wahrscheinlichkeiten basiert („Zu 99% ist das eine Katze“), kann sie sich irren. Wie ein Klavierschüler, der sich verspielt, kann auch eine perfekt trainierte KI Fehler machen.Das zu wissen ist wichtig: KI liefert keine absolute Wahrheit, sondern eine (sehr gute) statistische Schätzung.Glossar: Die Sprache des Trainings

| Begriff | Erklärung |

|---|---|

| Maschinelles Lernen (ML) | Der Oberbegriff für Systeme, die nicht fest programmiert sind, sondern durch Training aus Daten lernen. |

| Trainingsdaten | Das Material (Bilder, Texte, Töne), mit dem die KI übt. Ohne gute Daten kein gutes Lernen. |

| Modell | Das „fertige“ Ergebnis nach dem Training. So wie der Schüler nach dem Üben das Lied „kann“, kann das Modell die Aufgabe lösen. |

| Feedback-Schleife | Der Mechanismus, der der KI sagt: „Das war falsch“ oder „Das war richtig“, damit sie sich verbessern kann. |

Weiterführende Informationen

Interne Links

- vorheriges Kapitel – Wie erkenne ich KI im Alltag? (Versteckte Helfer)

- nächstes Kapitel – Der Blick unter die Haube: Neuronale Netze und Deep Learning